IA et Cybersécurité : comment les hackers utilisent les LLM pour leurs attaques

Vous pensiez que ChatGPT servait uniquement à rédiger des emails ou résumer des articles ? Les cybercriminels ont découvert un usage bien moins noble. Les grands modèles de langage (LLM) comme GPT-4, Claude ou Llama deviennent des armes redoutables entre de mauvaises mains. Ils automatisent des attaques qui nécessitaient autrefois des compétences techniques pointues.

Un pirate débutant peut aujourd'hui générer des emails de phishing indétectables, créer des malwares sophistiqués ou contourner des protections en quelques prompts bien formulés. Cette démocratisation du hacking transforme radicalement le paysage de la cybersécurité.

L'arsenal offensif des LLM pour les hackers

Les modèles de langage ne font pas qu'aider les pirates : ils multiplient leur efficacité par cent. Chaque capacité des LLM trouve une application malveillante détournée.

La génération de phishing ultra-personnalisé à grande échelle

Les anciens emails de phishing se repéraient à leurs fautes d'orthographe et leurs tournures maladroites. Depuis le lancement de ChatGPT en novembre 2022, les chercheurs rapportent une augmentation de 4 151% des emails malveillants. Cette explosion s'explique simplement : 67,4% de toutes les attaques de phishing en 2024 ont utilisé une forme d'IA comme le souligne CybelAngel.

Comment ça marche ?

Un LLM analyse votre profil LinkedIn, vos publications sur les réseaux sociaux, les communiqués de votre entreprise. En quelques secondes, il génère un email parfaitement rédigé imitant le style de votre supérieur hiérarchique, mentionnant des projets réels, utilisant le jargon interne exact. Des chercheurs d'Harvard ont découvert que 60% des destinataires tombent dans le piège d'emails de phishing générés par IA, un taux comparable aux attaques traditionnelles.

La scalabilité change radicalement la donne. Dans une expérience d'IBM, l'IA n'a nécessité que 5 prompts et 5 minutes pour créer une campagne aussi efficace que celle qui avait pris 16 heures à des experts humains. Un seul pirate peut désormais lancer des milliers de campagnes ultra-personnalisées simultanément, chaque email adapté à sa cible spécifique.

Les LLM "jailbreakés" : WormGPT, FraudGPT et leurs clones

Les LLM grand public comme ChatGPT ou Claude refusent poliment de générer du contenu malveillant. Leurs garde-fous bloquent les demandes suspectes. Mais les pirates ont contourné le problème en créant leurs propres modèles sans aucune restriction éthique : WormGPT, FraudGPT, DarkGPT, EvilGPT.

WormGPT, construit sur le modèle GPT-J et entraîné sur des données liées aux malwares, a été conçu explicitement pour un usage criminel : rédiger des emails de phishing impeccables, générer des malwares polymorphes et construire des messages de compromission d'emails professionnels. Ces outils ne nécessitent aucune compétence technique particulière : vous posez votre question en langage naturel, l'IA génère le code malveillant.

Le modèle économique ressemble à celui de Netflix. Les créateurs utilisent généralement une structure tarifaire allant de 60€ à 100€ par mois ou 550€ par an, certains proposant des configurations privées pour 5 000€. FraudGPT était vendu entre 200$ par mois et 1 700$ par an selon Daily Security Review, donnant l'accès à des capacités d'attaque sophistiquées.

La situation empire : de nouvelles variantes de WormGPT ont émergé, construites sur des LLM commerciaux comme Grok de xAI et Mixtral de Mistral. Ces agents modifiés sont promus dans des forums criminels avec des abonnements commençant autour de 60€. Les pirates ne construisent même plus de modèles depuis zéro : ils "jailbreakent" des LLM légitimes en manipulant leurs prompts système pour contourner les protections.

La génération automatique de malware et d'exploits

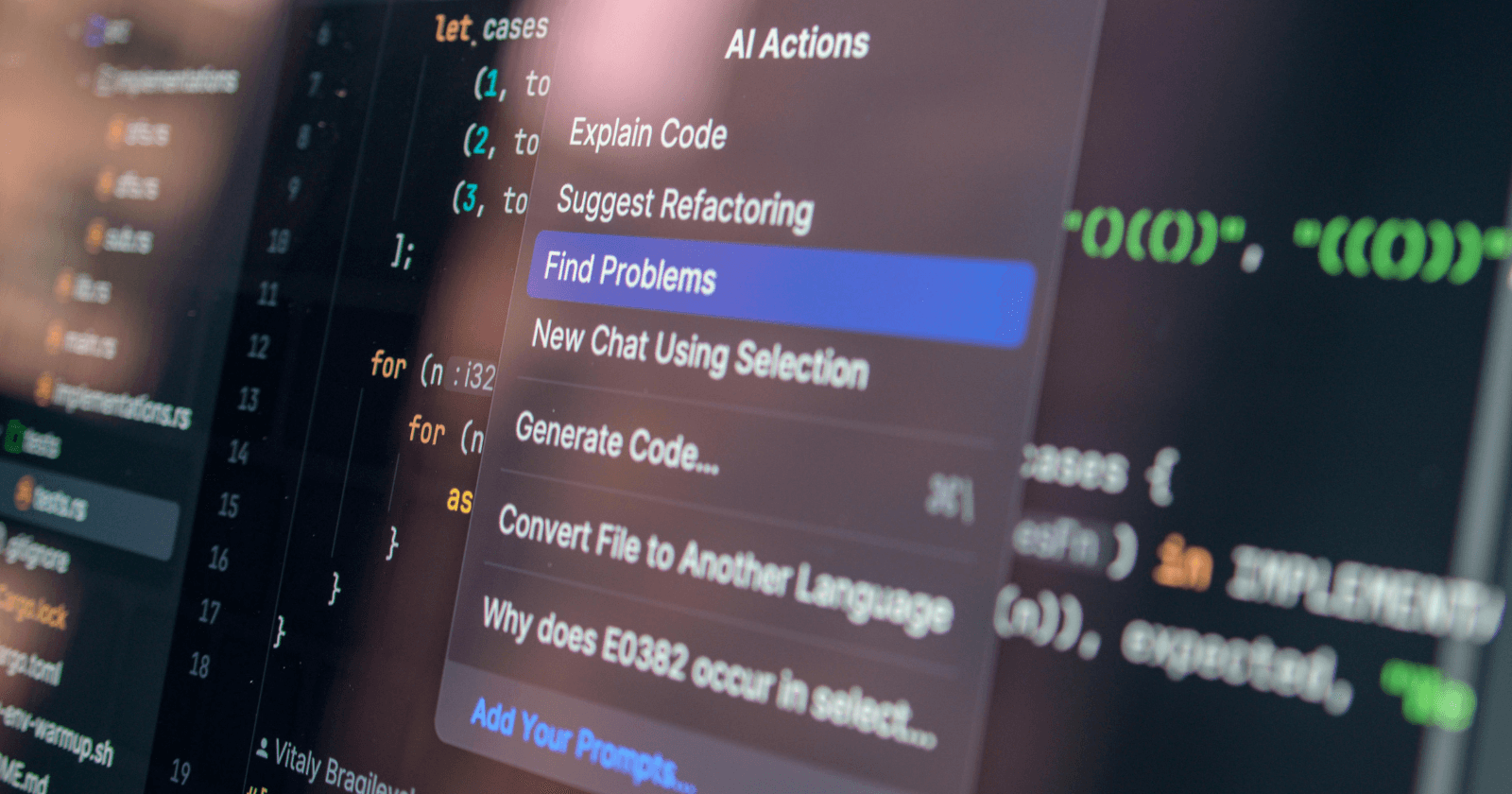

Les LLM ne se contentent pas d'écrire des emails de phishing. Ils génèrent également du code malveillant sophistiqué, une tâche qui nécessitait autrefois des années d'expertise en programmation. Des études académiques récentes montrent que plus de 40% des solutions de code générées par IA contiennent des failles de sécurité, même avec les LLM de dernière génération.

Le problème vient de l'entraînement : les LLM apprennent sur des millions de lignes de code publiques, incluant du code excellent mais aussi du code vulnérable. Face à des prompts naïfs, tous les LLM testés ont généré du code non sécurisé vulnérable à au moins quatre des dix faiblesses les plus courantes du système Common Weakness Enumeration. Les vulnérabilités typiques incluent : injection de commandes, XSS, téléchargement de fichiers non sécurisés, traversée de chemins.

Le pire modèle testé était GPT-4o d'OpenAI, avec seulement 10% de sorties exemptes de vulnérabilités suite à des prompts naïfs. GPT-4o n'atteignait que 20% de taux de réussite même quand le prompt précisait "assure-toi d'écrire du code sécurisé". Les pirates exploitent cette faiblesse : ils demandent au LLM de générer du code, puis l'utilisent directement pour construire leurs malwares.

Plus inquiétant encore : une étude de l'Université du Luxembourg révèle que les LLM peuvent être armés pour générer automatiquement des exploits fonctionnels à partir de divulgations publiques de vulnérabilités, transformant des attaquants novices en menaces capables. La technique RSA (Role-assignment, Scenario-pretexting, Action-solicitation) manipule les LLM pour contourner leurs mécanismes de sécurité et générer du code d'exploit fonctionnel. Des individus sans aucune expérience en cybersécurité ont réussi à exploiter des CVE en suivant simplement les instructions des LLM.

Les deepfakes vocaux et vidéo ultra-réalistes

En février 2024, un employé de la société d'ingénierie Arup a été piégé lors d'une visioconférence avec ce qui semblait être le directeur financier et d'autres cadres supérieurs de l'entreprise. Tous étaient des deepfakes. L'employé a autorisé 15 transactions totalisant 25 millions de dollars vers des comptes de Hong Kong.

Cette attaque a brisé toutes les hypothèses sur les capacités des deepfakes. Avant Hong Kong, la plupart des gens pensaient que les deepfakes étaient limités aux interactions individuelles ou aux images statiques. Cette attaque a démontré que les criminels pouvaient orchestrer des visioconférences complexes multi-personnes avec plusieurs participants générés par IA parlant et interagissant naturellement.

Les chiffres donnent le vertige. Les attaques deepfake contre les entreprises ont augmenté de 3 000% en 2023. La fraude par clonage vocal a spécifiquement augmenté de 680% au cours de l'année écoulé. Les pertes financières dues à la fraude facilitée par deepfake ont dépassé 200 millions de dollars au cours du premier trimestre 2025.

La barrière technologique s'est effondrée. Le clonage vocal nécessite aussi peu que trois secondes d'audio clair pour créer un clone. Des clones de meilleure qualité capturant les caractéristiques vocales subtiles peuvent nécessiter 10 à 30 secondes d'enregistrement. Une étude McAfee de 2024 a révélé qu'un adulte sur quatre a subi une arnaque vocale IA, avec un sur dix ayant été personnellement ciblé. C’est terrible : je sais que c’est ce que vous vous dites ;)

Comment les groupes APT utilisent les LLM

Les groupes de menaces persistantes avancées (APT) sponsorisés par des États exploitent également les LLM, bien que de manière plus sophistiquée que les cybercriminels ordinaires.

L'utilisation par les acteurs étatiques

En octobre 2024, les chercheurs ont rapporté que les acteurs nord-coréens exploitaient les LLM pour mieux comprendre les vulnérabilités divulguées publiquement, pour des tâches de script basiques et pour la reconnaissance de cibles (y compris la création de contenu dédié utilisé dans l'ingénierie sociale). Les groupes iraniens ont été vus générant des emails de phishing et utilisaient des LLM pour le web scraping. Les groupes chinois comme Charcoal Typhoon ont abusé des LLM pour des commandes avancées d’après The Hacker News.

Ces usages diffèrent selon les capacités et intérêts de chaque groupe, mais tous partagent un objectif : réduire le temps de développement des attaques. Ce qui prenait des semaines de recherche manuelle se fait désormais en quelques heures avec un LLM.

Les acteurs étatiques ont également exploité les chatbots légitimes. Le cluster chinois SweetSpecter (suivi comme TGR-STA-0043 par Palo Alto Networks) a même ciblé les employés d'OpenAI avec des attaques de spear-phishing. L'objectif : comprendre les faiblesses des systèmes de défense basés sur l'IA en attaquant directement leurs créateurs.

Les campagnes de désinformation automatisées

Récemment, des groupes de menaces sponsorisés par des États ont également été observés menant des campagnes de désinformation et d'influence ciblant l'élection présidentielle américaine. Plusieurs campagnes attribuées à des acteurs iraniens, russes et chinois ont exploité des outils IA pour éroder la confiance publique dans le système démocratique américain ou discréditer un candidat. Dans son rapport Digital Defense Report 2024, Microsoft a confirmé cette tendance. Des milliers de fausses publications générées quotidiennement, chacune adaptée à son audience cible.

Type d'attaque LLM | Temps de développement | Taux de réussite | Coût pour l'attaquant |

Phishing IA classique | 5 minutes | 60% | 0,50€/campagne |

Deepfake vocal | 10-30 minutes | 77% (victimes perdent argent) | 50-200€ |

Deepfake vidéo multi-personnes | 2-4 heures | 43% (professionnels finance) | 500-2000€ |

Malware généré par LLM | 1-2 heures | 40% contient vulnérabilités exploitables | 60-100€/mois (WormGPT) |

Exploit automatisé CVE | 30 minutes | Fonctionnel même sans expertise | Gratuit (LLM publics) |

Les risques émergents : prompt injection et empoisonnement de données

Au-delà des usages offensifs directs, les LLM introduisent de nouvelles classes de vulnérabilités que les entreprises commencent à peine à comprendre.

L'injection de prompts malveillants

Une vulnérabilité de sérialisation existe dans les fonctions dumps() et dumpd() de LangChain. Un attaquant peut exploiter cette faille pour voler des secrets sensibles et même influencer les réponses du modèle de langage via injection de prompt. Cette vulnérabilité, suivie comme CVE-2025-68664, porte un score CVSS de 9,3 sur 10,0.

Le vecteur d'attaque le plus courant passe par les champs de réponse LLM qui peuvent être contrôlés via injection de prompt puis sérialisés/désérialisés dans les opérations de streaming. Un chercheur en sécurité a commenté : "This is exactly the kind of 'AI meets classic security' intersection where organizations get caught off guard. LLM output is an untrusted input." .

L'empoisonnement de RAG et des données d'entraînement

Une recherche de 2024 appelée PoisonedRAG a démontré qu'en ajoutant seulement 5 documents malveillants dans un corpus de millions, l'IA ciblée retournerait les fausses réponses souhaitées par l'attaquant 90% du temps pour des questions déclencheurs spécifiques.

Cette attaque ressemble à une attaque de chaîne d'approvisionnement : au lieu d'empoisonner une bibliothèque logicielle, l'attaquant empoisonne votre bibliothèque de données. Contrairement à un hack évident, cela peut passer inaperçu car l'IA fait techniquement son travail ; récupérer des informations pertinentes sauf que l'information a été sabotée.

Les fuites de données via les LLM internes

Samsung a temporairement interdit ChatGPT après avoir découvert que des ingénieurs avaient accidentellement divulgué du code source confidentiel en le collant dans ChatGPT. Les banques de Wall Street comme JPMorgan et Goldman Sachs ont également restreint ChatGPT après avoir découvert que des employés y avaient partagé des informations sensibles.

Le problème s'étend bien au-delà de ces cas médiatisés. Un rapport industriel de LayerX en 2025 a révélé que 77% des employés d'entreprise qui utilisent l'IA ont collé des données d'entreprise dans une requête de chatbot, et 22% de ces instances incluaient des données personnelles ou financières confidentielles.

Les défenses qui fonctionnent vraiment

Face à cette avalanche de menaces, quelles protections offrent une réelle efficacité ? La réponse combine technologie et formation humaine.

La détection basée sur l'IA elle-même

Le paradoxe de la cybersécurité moderne : utiliser l'IA pour combattre l'IA. Les systèmes basés sur l'IA peuvent identifier des modèles de communication inhabituels et détecter des changements dans le comportement typique des utilisateurs, aidant à prévenir des escroqueries sophistiquées d’après SOCRadar.

Ces systèmes analysent le contexte et le comportement des emails. Ils cherchent des anomalies et des signaux d'alerte : expéditeurs forgés, domaines avec fautes de frappe, langage urgent signalant une tentative de phishing. En comprenant le contexte des messages, les systèmes IA peuvent distinguer le spam des menaces réelles, fournissant une défense contre le phishing. Cette course à l'armement IA-contre-IA n'est pas gagnée d'avance. Les attaquants adaptent constamment leurs techniques pour contourner les détections. La vigilance humaine reste indispensable.

L'authentification multi-facteurs résistante au phishing

L'authentification à deux facteurs traditionnelle (2FA) par SMS devient insuffisante. Les deepfakes peuvent contourner les vérifications d'authentification traditionnelles en exploitant la confiance humaine dans les voix familières et les contextes apparemment crédibles.

La solution : l'authentification résistante au phishing utilisant des clés de sécurité physiques ou l'authentification biométrique multi-modale. Ces méthodes nécessitent une présence physique ou des caractéristiques biologiques impossibles à deepfaker à distance.

Les entreprises devraient également implémenter des protocoles de vérification hors bande : toute demande financière importante doit être confirmée via un canal de communication différent. Un email suspect ? Appelez le numéro officiel de l'entreprise (pas celui fourni dans l'email). Un appel vidéo urgent ? Raccrochez et rappelez via le système interne.

La formation continue et les simulations réalistes

La meilleure préparation n'est pas la réaction ; c'est la simulation. En répétant des scénarios de deepfake et de phishing avant qu'ils n'arrivent, votre équipe développe les réflexes pour repérer les indices subtils, vérifier les demandes et arrêter la fraude sur place.

Le rapport de la National Cybersecurity Alliance de 2024 a révélé que seulement 48% des employés avaient reçu une formation liée à l'IA en matière de sécurité. Cette lacune est dangereuse. La formation doit désormais inclure :

Reconnaissance des deepfakes : indices visuels (clignotements anormaux, synchronisation labiale imparfaite), indices auditifs (respirations absentes, intonations robotiques)

Protocoles de vérification : phrase secrète familiale pour les appels urgents, questions personnelles que seul le vrai interlocuteur connaît

Conscience des tactiques d'urgence : 90% des attaques exploitent l'urgence artificielle pour court-circuiter le jugement

Les simulations doivent être personnalisées par rôle : un responsable RH fait face à des risques liés aux informations des employés. Une personne en finance est bien plus susceptible d'être ciblée par des tentatives de fraude aux factures ou d'usurpation d'identité de dirigeants.

Les politiques strictes d'utilisation des LLM

Les entreprises doivent établir des garde-fous clairs pour l'utilisation interne des LLM :

Interdictions formelles :

Ne jamais coller du code source, des données clients, des prévisions financières ou toute donnée non publique dans un outil IA non approuvé explicitement par l'IT

Ne jamais utiliser d'IA générative pour traiter des informations couvertes par RGPD, HIPAA ou autres réglementations

Outils approuvés uniquement :

Maintenir une liste blanche d'outils IA validés avec des contrats garantissant la non-utilisation des données pour l'entraînement

Privilégier les instances auto-hébergées ou les API avec garanties de confidentialité

Audit et surveillance :

Monitorer l'utilisation des LLM via des solutions DLP (Data Loss Prevention)

Analyser les requêtes sortantes vers des services IA externes

Implémenter des alertes sur les tentatives de partage de données sensibles

L'avenir : une escalade inévitable ?

La course à l'armement entre attaquants et défenseurs s'accélère. Les LLM deviennent simultanément plus puissants et plus accessibles. Les attaques deviennent plus sophistiquées.

Les prédictions pour 2026-2027

Gartner prédit qu'en 2026, les entreprises combinant l'IA générative avec une architecture basée sur des plateformes intégrées dans les programmes de comportement et de culture de sécurité connaîtront 40% d'incidents de cybersécurité causés par les employés en moins. Cette prévision optimiste suppose toutefois que les entreprises investissent massivement dans la formation et la technologie.

Côté attaquants, les experts anticipent :

Deepfakes temps réel indétectables : vidéoconférences entièrement générées par IA impossibles à distinguer de la réalité

Agents IA autonomes : malwares capables d'adapter leurs tactiques en temps réel selon les défenses rencontrées

Attaques multi-modales coordonnées : combinant phishing, deepfakes vocaux, falsification de documents et ingénierie sociale simultanément

Le besoin urgent de régulation

L'Acte sur l'IA de l'Union européenne, entré en vigueur en août 2024, mandate des obligations de transparence et un marquage technique pour le contenu généré par IA. Les États-Unis manquent de législation fédérale complète, bien que plusieurs projets de loi progressent au Congrès selon ScamWatchHQ.

Le défi pour les régulateurs : la technologie évolue plus vite que les lois ne peuvent être écrites et implémentées. Lorsqu'une régulation est adoptée, les attaquants utilisent déjà des techniques de génération suivante.

Point d'action immédiat

Testez votre vulnérabilité dès aujourd'hui : organisez un exercice interne où un membre de votre équipe sécurité tente de créer un deepfake vocal d'un dirigeant en utilisant uniquement des sources publiques (interviews YouTube, podcasts, conférences). Si la voix générée trompe plus de 30% de vos employés lors d'un test en aveugle, vos protocoles de vérification sont insuffisants. Implémentez immédiatement un système de phrase secrète ou de vérification hors bande pour toutes les demandes financières.

L'intelligence artificielle transforme la cybersécurité en une course permanente entre innovation offensive et défensive. Les LLM fournissent des capacités extraordinaires qui bénéficient autant aux attaquants qu'aux défenseurs. La différence entre une entreprise compromise et une entreprise protégée réside dans trois facteurs : la rapidité d'adaptation, l'investissement dans la formation humaine, et l'adoption de technologies de défense basées sur l'IA. Les organisations qui considèrent encore la sécurité comme une dépense plutôt qu'un investissement stratégique paieront le prix fort dans les années à venir.